AI 심리 상담, 24시간 도움과 개인정보 논란

플랭크

- 긴 상담 대기 시간 줄이는 AI의 힘, 그러나 논란 속 규제 확산.

- 공감 부족 및 데이터 유출 우려…미국 여러 주에서 법적 제동.

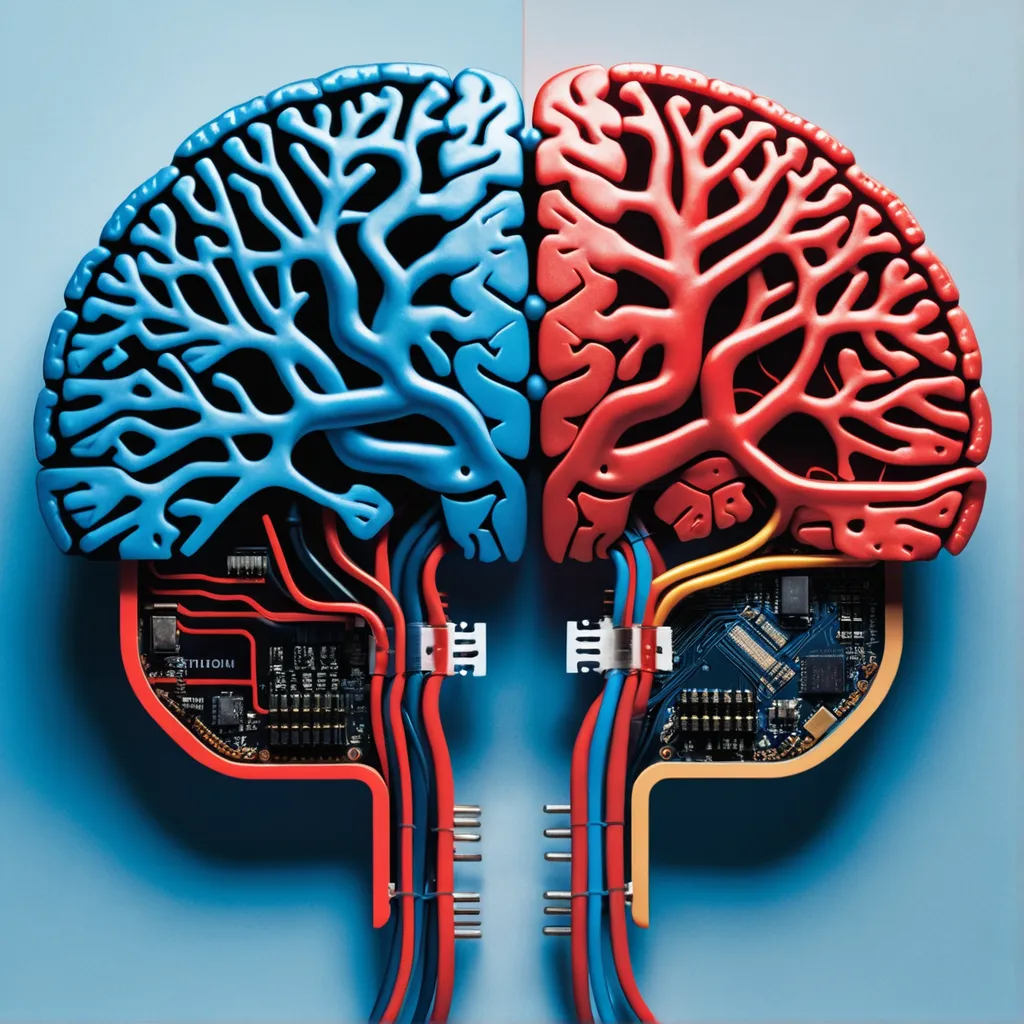

AI 심리 상담 서비스, 혁신인가 위기인가?

23일(현지시각) 미국 씨엔엔(CNN)에 따르면 AI 기반 심리 상담 서비스가 편리함과 한계를 동시에 안고 전 세계에서 논란이 된다. AI 챗봇은 시간과 장소의 제약에서 자유로워 심리 상담의 새로운 방법으로 주목받는다. 하지만 개인정보 유출과 정서적 공감 부족 등 우려도 커지고 있다. 이에 미국 일부 주에서는 이를 제한하는 법안을 내놓고 규제를 강화한다.

AI 심리 상담 서비스는 대화형 챗봇을 통해 사용자에게 정서적 지원을 제공한다. 또한 24시간 접근 가능하고 다국어를 지원한다는 점에서 긍정적으로 평가받는다. 2023년 캐나다 퀘벡의 AI 컨설턴트 피에르 코테(Pierre Côté)는 개발한 챗봇 닥터엘리스닷에이아이(DrEllis.ai)가 자신을 포함한 많은 사용자에게 심리적 안정을 제공했다고 밝혔다. 이러한 기술은 전통적 심리 상담의 긴 대기 시간을 크게 줄이고 상담 접근성을 높이는 혁신 기술로 떠오른다.

그러나 기술의 한계 또한 뚜렷하다는 지적이 나온다. 더블린시티대학(Dublin City University) 심리치료 강사 나이젤 멀리건(Nigel Mulligan) 박사는 "AI는 인간적인 정서나 공감이 필요한 상황에서 완전히 대체할 수 없다"고 말했다. 그는 치료적 관계를 형성하는 데 기술로는 한계가 있다는 점을 강조했다. 따라서 위기 상황에서 AI가 적절히 대응하지 못해 심리적 피해를 초래할 가능성도 우려된다.

또한, 개인정보 보호 문제가 또 다른 주요 논점으로 부각된다. 킹스 칼리지 런던(King's College London)의 케이트 데블린(Kate Devlin) 교수는 AI 챗봇이 대화를 통해 수집한 민감한 정보를 빅테크 기업들이 상업적 용도로 활용하거나 유출할 가능성을 경고했다. 그리고 감시와 통제가 필요하다고 주장했다.

이런 우려 속에서 일부 지역에서는 제한적인 법적 조치가 시행된다. 지난 8월, 일리노이주가 네바다주와 유타주에 이어 AI 상담 기술을 규제하는 법률을 도입했다. 이 법률은 특히 청소년의 심리 상담에서 AI 이용을 제한하며 사회적 약자 보호에 중점을 둔다.

텍사스 법무장관은 AI 챗봇을 개발한 메타(Meta)와 캐릭터닷에이아이(Character.AI)를 대상으로 민사 조사를 시작했다. 이들 기업은 자격 있는 치료사처럼 챗봇을 홍보하고, 사용자 데이터를 부적절하게 관리했다는 혐의를 받는다. 실제로 캐릭터닷에이아이는 작년 청소년 사용자들로부터 정신적 피해를 유발했다는 이유로 소송에 휘말린 바 있어 논란이 뜨겁다.

임상 심리학자인 스콧 월리스(Scott Wallace) 박사도 AI 챗봇으로 진행되는 심리 상담에 회의적인 입장을 밝혔다. 그는 "사용자들이 AI와 대화하면서 진정한 정서적 소통이 이루어지고 있다고 착각할 가능성이 위험하다"고 지적했다. 더불어 AI 기술이 아직 인간 상담의 수준에 도달하기에는 많은 한계가 있다고 분석했다.

2025년 8월23일 15시(UTC) 기준, AI 서비스 관련 주요 기업들의 주식은 미국 법적 규제 이슈로 인해 혼조세를 보인다. 특히 메타와 캐릭터닷에이아이에 대한 텍사스 조사 발표 이후 두 기업 관련 언급량이 급증하며 투자자들의 관심을 끈다.

AI 기반 심리 상담 서비스는 전통적인 방법의 대안으로 자리 잡지만, 그 한계와 윤리적 문제로 인해 논란이 커진다. 지속적인 기술 발전과 함께 이 문제에 대한 사회적 합의와 적절한 규제 조치가 필요하다.

최신소식을 메일로 받아보세요.